Expert în apărare: Poate reglementarea să împiedice inteligența artificială să distrugă omenirea?

Redăm argumentele Kenneth Payne dintr-un editorial publicat în The Spectator.

***

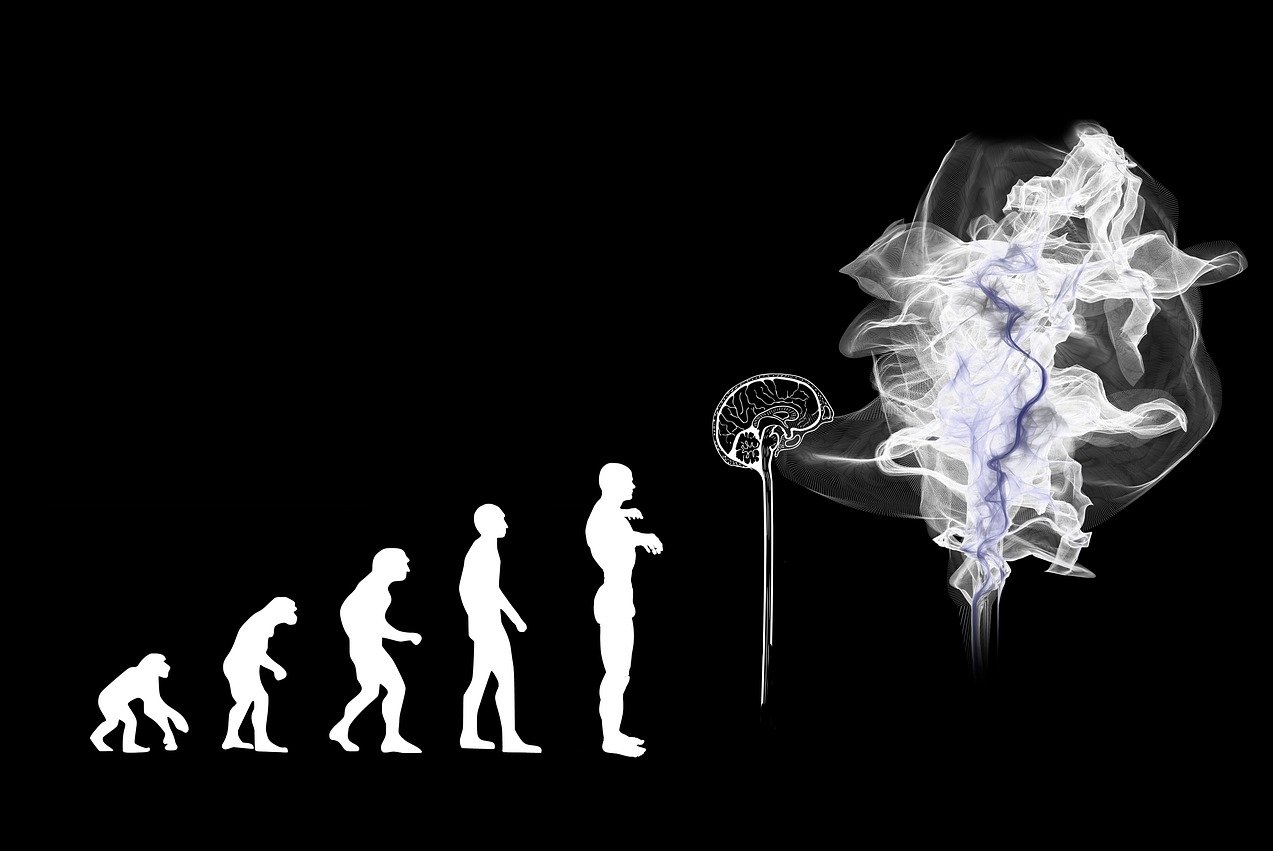

Sosirea unei inteligențe artificiale (IA) super-inteligente ar putea distruge omenirea. Aceasta este teama unor personalități importante din domeniul inteligenței artificiale, care au semnat o scrisoare deschisă prin care solicită ca siguranța IA să fie o „prioritate globală”. Geoffrey Hinton, o figură legendară în rândul cercetătorilor în domeniul IA, a părăsit recent Google și a tras un semnal de alarmă. „Este pentru prima dată în istoria omenirii când suntem pe punctul de a dezvolta ceva mai inteligent decât noi”, a declarat el pentru The Spectator. „S-ar putea să devenim istorie”. Șaizeci și unu la sută dintre americanii intervievați recent de Ipsos sunt de acord cu el, și anume că IA reprezintă o amenințare pentru civilizație.

Sam Altman, directorul general al OpenAI și arhitectul șef al ChatGPT, este un susținător entuziast al unei inteligențe artificiale mai puternice și al schimbărilor pozitive pe care aceasta le-ar putea aduce. Dar, apărând recent în fața Congresului, el a exprimat, de asemenea, „cele mai mari temeri” ale sale că această tehnologie „provoacă daune semnificative lumii”. De asemenea, el a făcut apel la reglementare, surprinzându-i pe senatorii neobișnuiți cu întreprinderile care pledează pentru un control guvernamental mai strict.

Altman s-a întâlnit cu Rishi Sunak în Downing Street săptămâna trecută, probabil pentru a-și repeta mesajul. La eveniment a participat și Demis Hassabis, fondatorul remarcabilei DeepMind, compania de inteligență artificială cu sediul la Londra, dedicată „rezolvării inteligenței”. După întâlnire, Nr. 10 a recunoscut pentru prima dată riscul „existențial” al IA.

În declarația Centrului pentru Siguranța IA, publicată astăzi, se afirmă că: „În acest moment, nu există niciun pericol al IA. Atenuarea riscului de extincție cauzat de IA ar trebui să fie o prioritate globală, alături de alte riscuri la scară societală, cum ar fi pandemiile și războiul nuclear.”

Nu este singurul grup care face comparația nucleară. OpenAI a publicat recent un memorandum privind guvernanța IA care aduce în mod explicit comparația. Potrivit companiei, este posibil să avem nevoie de ceva asemănător cu autoritatea internațională de reglementare nucleară pentru eforturile de superinteligență. Agenția Internațională pentru Energie Atomică a coordonat, de la mijlocul anilor 1950, eforturile interguvernamentale de promovare a utilizării pașnice a energiei nucleare și de protecție împotriva proliferării armelor nucleare, fără îndoială cu un oarecare succes.

Este analogia cu armele nucleare cea corectă? La suprafață, comparația pare intuitiv plauzibilă. Ambele sunt tehnologii costisitoare, complexe și cu riscuri uriașe. Totuși, la o analiză mai atentă, analogia pare firavă.

În primul rând, spre deosebire de o explozie nucleară, nu există o idee clară despre ce este o superinteligență, cu atât mai puțin despre cum ar putea apărea. Inteligența artificială de astăzi este deja superinteligentă în unele sarcini, cum ar fi plierea proteinelor, dar este remarcabil de slabă în altele. Se presupune că o superinteligență autentică ar trebui să depășească inteligența umană în general, nu doar în domenii restrânse.

De asemenea, nu este clar cum se poate ajunge la superinteligență. Va fi suficient să continuăm pe calea actuală trasată de ChatGPT – cu o rețea de „neuroni” artificiali antrenați pe un corpus vast de date care rulează pe un hardware din ce în ce mai puternic? Nimeni nu știe, nici măcar OpenAI.

Apelurile OpenAI pentru un regulator de tip nuclear s-ar aplica, spun ei, sistemelor „peste un anumit prag de capacitate (sau de resurse, cum ar fi calculul)”. Acest lucru este problematic din două puncte de vedere. Prima abordare măsoară producția, dar este greu să reglementezi producția atunci când nu poți specifica cu precizie ceea ce cauți. Alternativa, care măsoară în funcție de intrare, cel mai probabil puterea de calcul, este puțin mai bună. În prezent, crearea unei inteligențe artificiale de ultimă generație este foarte solicitantă din punct de vedere computațional și, prin urmare, extrem de costisitoare. Acesta este unul dintre motivele pentru care DeepMind și-a unit forțele cu Google, care deținea computere extrem de puternice și o mulțime de date pe care să antreneze modelele DeepMind. Dar și multe alte activități au nevoie de calculatoare puternice. Și, bineînțeles, supercomputerul de astăzi, lider mondial, este inevitabil laptopul de mâine. În plus, nu este de la sine înțeles că superinteligența va avea nevoie de atât de multă putere. S-ar putea ca sosul secret să nu fie o rețea de tip GPT la scară mare, ci o altă tehnică. Din nou, dacă nu poți specifica ce anume reglementezi, există puține șanse de a o face.

Reglementarea nucleară a fost relativ simplă dintr-un alt motiv: guvernele au fost singurii actori care au contat. Fabricarea bombelor necesita izotopi rari de uraniu și plutoniu, ceea ce presupunea un efort industrial major. Statele au păstrat un control ferm asupra mijloacelor de producție și, în interesul securității naționale, au adunat expertiza necesară. Bineînțeles, au monopolizat și producția.

Relația dintre actorii publici și cei privați este mai complexă de această dată. În ultimele două decenii, o mână de giganți din domeniul tehnologiei au ajuns să domine cercetarea în domeniul inteligenței artificiale, atrăgând expertiza de la universități și de la guvern și reducând la minimum cheltuielile tuturor celorlalți, chiar și ale Pentagonului. Este cu siguranță posibil să se reglementeze actori privați ca aceștia. Meta tocmai a fost amendată de UE cu 1,2 miliarde de euro pentru gestionarea defectuoasă a datelor utilizatorilor. Dar există provocări. Aceste companii globale sunt atât de mari încât orice guvern pare o bere mică – chiar și un stat atât de mare ca Marea Britanie, care se luptă în prezent cu Meta pentru accesul prin ușa din spate la mesajele criptate ale utilizatorilor săi de pe WhatsApp.

Chiar și presupunând că ați putea reglementa acești titani moderni, există o altă problemă: s-ar putea să căutați unde nu trebuie. O notă recentă, aparent scrisă de persoane din interiorul Google, susținea că puterea ar putea să se îndepărteze de marii jucători. Ce se întâmplă dacă giganții, Google, Microsoft sau Meta, se îndreaptă parțial spre superinteligență prin intermediul unui model mare, dar acesta se scurge apoi către terți care duc la final proiectul?

Chiar și presupunând că toate aceste provocări ar putea fi abordate, există o ultimă dificultate, probabil insurmontabilă: dilema securității. Teama de capacitățile unui adversar reprezintă un stimulent puternic pentru a dobândi propriile capacități. Când a venit vorba de energia atomică, regimul de control strict al armelor a însemnat o justiție a învingătorilor. După ce au dezvoltat bomba, SUA (și alte câteva state) au ridicat podul mobil, prin înființarea mai întâi a AIEA și apoi a Tratatului de neproliferare nucleară. Ulterior, doar câteva state au ajuns să dețină arme nucleare, iar unele dintre cele care au căutat capacități de pătrundere au fost zădărnicite de rivali.

Acest tip de control strict va fi imposibil de data aceasta. Cercetarea în domeniul inteligenței artificiale, la fel ca expertiza nucleară, este distribuită inegal între state, dar de data aceasta barierele internaționale de intrare sunt mult mai mici; puterea calculatoarelor nu este la fel de rară și de ușor de urmărit ca uraniul. Dacă superinteligența este atât de transformatoare precum sugerează OpenAI și alții, există un stimulent puternic pentru a trișa și o mulțime de oportunități pentru a face acest lucru. S-ar putea să nu aveți nevoie nici măcar de cei mai străluciți oameni de știință în domeniul informaticii – este suficient să așteptați ca o pistă promițătoare să apară de la un concurent și apoi să vă însămânțați efortul de cercetare cu ea. Între timp, spre deosebire de silozurile prost camuflate din timpul crizei rachetelor cubaneze, ați putea transporta pe ascuns superinteligența finalizată pe un hard disk. Proliferarea pare relativ ușoară.

Superinteligența pare încă incredibilă. Entuziasmul la modă din ultimele săptămâni ar putea dispărea în curând, pe măsură ce ChatGPT este absorbit în cotidian, la fel ca alte inovații tehnologice dinaintea sa. Există multe alte preocupări mai presante și imediate pentru guvern și societate. Problema, totuși, este reală: un risc mic, dar în creștere, pentru umanitate, cu consecințe potențial devastatoare. Sugestiile de reglementare ale OpenAI sunt inadecvate, dar adevăratul serviciu pe care Altman și compania l-au făcut este acela de a trage un semnal de alarmă. Este nevoie rapid de idei noi.

Urmărește-ne pe Google News

Urmărește-ne pe Google News